美AI競賽全面領先 習近平也驚呆!川普用1招解電力瓶頸

...立一個工業。」並重新將輝達定義為將「電子」轉換為「Token」的關鍵角色,強烈指出所有運算能力的前提...

...立一個工業。」並重新將輝達定義為將「電子」轉換為「Token」的關鍵角色,強烈指出所有運算能力的前提...

...示,Agentic AI除了加速GPU與ASIC在Token生成上的需求外,其自動化任務執行過程,同...

...AI Agent工作流與生成式AI應用,也持續加速Token消耗速度。他表示,這些技術背後,正推動A...

...ing)轉向推理(Inference)階段,形成以Token經濟為核心的飛輪效應(Flywheel ...

...升高階NAND需求。 苟嘉章指出,AI服務已進入Token經濟學(Token Economics)...

...低企業資料外洩風險,也能協助客戶節省超過70%以上Token使用成本,對Agentic AI(AI代...

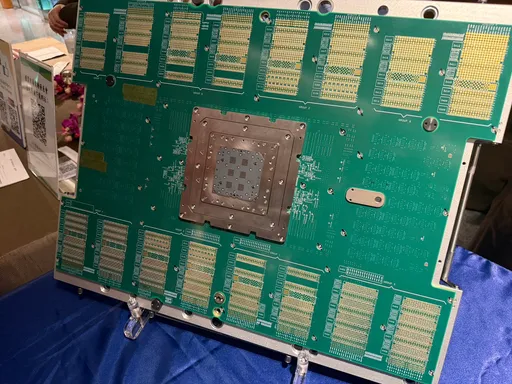

【記者呂承哲/苗栗報導】台灣IC設計龍頭聯發科技(2454)今(7)日正式宣布,啟用位於苗栗銅鑼科學園區的研發資料中心,首度曝光以NVIDIA DGX B200平台打造的NVIDIA DGX SuperPOD AI運算叢集,為全台首座採用B200 SuperPOD架構的AI高算力平台之一,主要支援AI模型訓練、推論與IC設計研發需求,將成為聯發科全球AI與雲端研發的重要基礎設施。

...,深化與當地IDM及封測廠合作。 隨著AI應用與Token使用量持續成長,產業模式逐步由硬體製造轉...

...I Governance則透過RBAC、護欄機制與Token成本控管,確保模型調用可被管理,並導入零...

...,模型迭代頻率提升,甚至已出現「用AI開發AI」,Token使用量持續攀升,顯示算力需求仍在快速擴張...

...支撐景氣動能,從生成式AI發展至代理式AI,詞元(Token)消耗數增加,提升算力需求,推升先進製程...

...型能力讓世界驚艷,而是讓中國的AI用戶能低成本調用Token(詞元)。DeepSeek這一次邁出的,...

...企業關注AI導入成本問題,王耀煒指出,目前市場多以Token計價,但Infobip採用「AI Cre...

...,AI硬體規格升級速度更快,需求從訓練延伸至推論,Token消耗與應用場景快速擴大,包括AI代理與機...

...承指出,AI代理模式需多次推理與自我運行,單次任務Token消耗為傳統模式10至50倍。隨產業成長,...

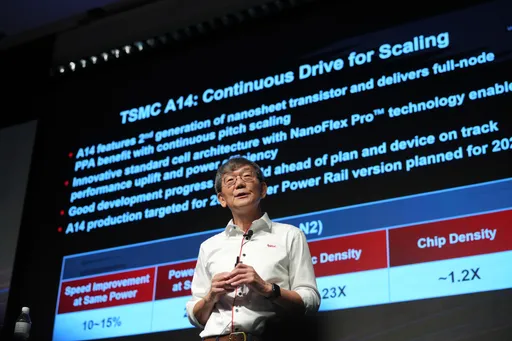

【記者呂承哲/台北報導】全球晶圓代工龍頭台積電(2330)公布2025年年報,董事長暨總裁魏哲家於致股東報告書指出,受惠人工智慧(AI)需求全年強勁,公司營收與每股盈餘雙雙創下歷史新高,並強調AI將持續帶動半導體長期結構性需求。

...30%成長。隨AI需求升溫,先進製程產能更趨緊俏,Token使用量快速增加,帶動台積電加速擴產。報告...

...布局。 產業面來看,AI已由訓練邁向推論階段,「Token經濟學」逐步成形,算力商業化路徑趨於明確...

...uant並非全新概念,隨著AI運算成本下降、可處理Token數量提升,反而有助刺激應用需求、擴大市場...

...新投信ETF團隊指出,在GTC大會中,黃仁勳提出「Token經濟學」概念,預期AI應用需求將持續爆發...