AI進入推論時代 Agentic AI帶動多代理協作

蕭聖倫表示,過去AI發展以模型訓練為核心,隨GPT等大型模型參數規模快速擴大,帶動算力需求顯著成長。然而,隨模型容量與資料來源逐漸接近極限,訓練端成長動能已放緩。

相較之下,推論(Inference)需求快速崛起,尤其在具備「推理能力」模型推出後,透過增加推論算力與運算時間,可有效提升模型表現,使「思考型模型」逐漸成為主流方向。

他指出,包括DeepSeek等新興模型亦顯示,在較低算力條件下仍具競爭力,進一步強化產業由訓練轉向推論的趨勢。

在應用層面,Agentic AI已由文字生成延伸至工具操作、任務規劃與記憶管理,並透過多代理(Multi-Agent)協作形成集體智慧。市場上已出現NotebookLM等知識整理工具,以及Anthropic推出的Claude Code與Computer Use功能,透過「技能(Skill)」機制賦予代理不同能力;影像與影音生成亦快速發展,在中國市場尤為活躍。

從產業結構來看,目前企業AI市場由雲端服務商、企業軟體公司、IT大廠與AI模型新創四大陣營競逐。以Microsoft為例,其透過Azure結合Microsoft 365與Copilot服務強化SaaS布局,並以PaaS提供模型與Agent管理能力,整合外部模型資源形成完整生態系。

超大規模雲端服務供應商(Hyperscaler)亦積極推動混合雲模式,讓企業可在地端部署部分GPU並搭配雲端算力使用,降低導入門檻。

GenAI應用分為六大類 AI伺服器架構走向多元資源協同

蕭聖倫分析,目前GenAI應用可分為六大類,包括Chatbot、協作與程式開發(Co-work/Cloud Code)、企業營運自動化、影像生成,以及製造現場應用,其中Chatbot已逐步成熟,而企業營運自動化結合Agent並串接ERP、CRM系統,成為新一波成長動能;影像與影音生成仍受限於算力與技術,處於成長階段。在硬體層面,AI負載變化正重新定義系統瓶頸,過去訓練階段主要受限於GPU高速互聯能力,如NVIDIA透過NVLink強化(scale-up)架構。

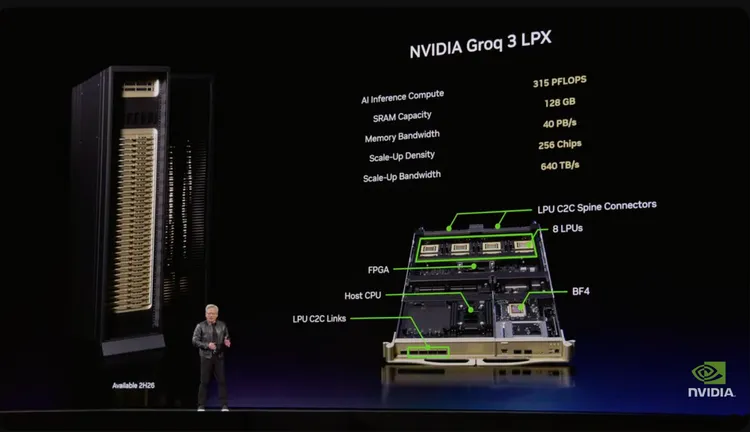

但隨推論與多代理系統興起,瓶頸逐漸轉向記憶體頻寬與容量,特別是HBM資源,同時CPU與系統記憶體負載亦明顯提升,顯示AI伺服器正走向多元資源協同。在推論場景中,系統需在回應延遲與整體吞吐量之間取得平衡。蕭聖倫指出,輝達執行長黃仁勳近年持續強調此一指標,並透過架構演進擴大效能邊界。

蕭聖倫說明,AI運算流程亦已拆分為預填(Prefill)與解碼(Decode),甚至細分至Attention與FFN等模組,並由不同硬體分工處理,例如導入LPU可降低延遲並提升吞吐量,顯示未來將朝異質運算與軟硬體協同優化發展。

以Microsoft為例,其AI布局仍以IaaS為核心,並逐步降低對單一模型供應商依賴,轉向多元合作與自研晶片策略。在出貨展望方面,搭載HBM與先進封裝(如CoWoS)的高階AI伺服器,2025年出貨已突破百萬台,2026年有望接近翻倍成長,其中ASIC成長速度將快於GPU,Google TPU與Amazon Trainium等需求持續提升。

隨供應鏈瓶頸逐步緩解,2026年將成為高階AI伺服器出貨爆發的重要一年,未來數年仍可望維持40%至50%成長動能。

AI硬體兩大主軸浮現!LPU拚高效推論 矽光子「光銅並進」

蕭聖倫會後受訪表示,隨AI由訓練轉向大規模推論,晶片架構與商業模式同步調整,產業由追求極致效能轉向效能與成本平衡。過去降規產品如CPX雖採先進封裝與HBM,但因效能較低難維持高價,反映市場競爭與成本壓力。

在記憶體與先進封裝產能仍有限下,業者已轉向優先銷售高毛利產品。在新一代架構中,LPU與LPX機櫃方案成為焦點,鎖定對延遲敏感的高價值應用;相對地,一般服務仍以GPU為主,透過大規模運算提升效率,顯示AI應用將呈現分層發展。

蕭聖倫指出,LPU多以整體機櫃解決方案銷售,單一系統價格可達數百萬美元,並依應用需求彈性配置。

整體來看,AI基礎設施需求仍強勁,且由需求端、模型與硬體三方同步推進,產業處於高速發展階段。在矽光子技術路線上,CPO與銅連接將並行發展,「光銅並進」成為主流趨勢,顯示AI基礎設施仍在快速演進中。

點擊閱讀下一則新聞

點擊閱讀下一則新聞