目前市場討論多集中於AI加速器出貨,但Counterpoint針對Google、AWS、Microsoft、Meta等主要超大規模業者的主機CPU配置比例進行追蹤,顯示另一個較少被關注的需求轉變正同步發生。

過去三年中,x86 CPU在AI基礎設施中的配置仍占主導地位,主要業者在現有ASIC伺服器部署中,仍依賴Intel與AMD作為主機CPU,反映軟體相容性與既有架構延續。然而,隨著半客製化AI加速器與XPU推動異質運算需求增加,基於ArmNeoverse核心的伺服器CPU採用持續提升。

此一轉變主要由成本與效率驅動。透過自研主機處理器並與AI加速器整合,業者可降低對商用晶片供應商依賴、提升利潤並降低整體運算成本(tokencost)。Arm架構CPU最初用於通用雲端,現已逐步導入AI伺服器,相較同級x86配置,在每瓦效能上可達約兩倍表現,在電力受限的資料中心環境具優勢。

Counterpoint研究專員DavidWu表示,目前x86在AI基礎設施中仍具一定比重,但從世代演進來看,優勢正快速轉向Arm客製化設計,預期2026年下半年轉變將更明顯,而各超大規模業者由x86轉向Arm的時點,將成為重要觀察指標。

在實際導入方面,Google已在下一代TPU基礎設施導入Axion Arm CPU;AWS則在Trainium平台中提升Graviton處理器比重,同時保留部分x86以維持相容性;Microsoft則自一開始即將Azure Cobalt Arm CPU與Maia AI加速器整合使用。

另一方面,Meta亦已確認Arm為其下一代MTIA基礎設施的策略CPU合作夥伴,並成為Arm首款AGI CPU的首批客戶,顯示從商用x86轉向Arm已成產業趨勢,而非單一決策。

Counterpoint研究副總裁NeilShah指出,AI伺服器CPU轉換並非一次性變革,而是隨不同世代逐步演進,業者會依需求進行配置並建立相容軟體環境,經濟效益明確。隨著主要業者在新一代ASIC平台導入自研ArmCPU,此轉變將於2026年下半年加速。

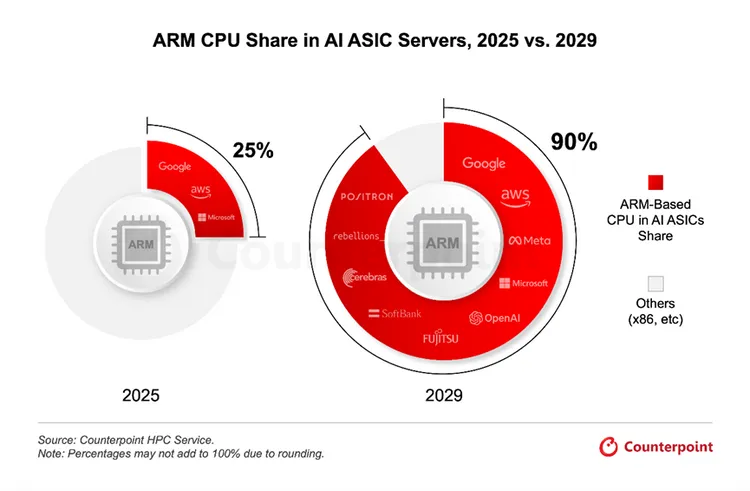

Shah進一步指出,預估至2029年,Arm架構CPU在客製化AI ASIC伺服器主機CPU的占比將達90%,相較2025年約25%大幅提升,反映超大規模業者導入自研ArmCPU所帶來的結構性變化。

點擊閱讀下一則新聞

點擊閱讀下一則新聞