思科表示,該方案結合液冷架構與高密度光學技術,旨在突破AI網路頻寬與功耗瓶頸,協助企業在AI訓練與推理規模持續放大的環境中,提升基礎設施效率與可擴展性。

思科指出,隨著AI模型規模與資料傳輸量爆發成長,網路已成為影響算力效率的關鍵因素。Silicon One G300導入智慧集體網路技術,整合共享封包緩衝、路徑式負載平衡與主動網路遙測,可吸收AI流量突發高峰並提升傳輸穩定度。官方模擬顯示,新架構可提升33%網路使用率,並將作業完成時間縮短28%,有助於提升AI資料中心每GPU算力產出與整體投資報酬率。

在架構設計上,G300採高度可程式化理念,支援部署後持續升級新功能,讓設備可因應未來網路協定與AI應用需求演進,延長基礎設施使用週期。同時晶片內建資安機制,強化叢集級防護能力,確保大型AI環境穩定運行。思科強調,Silicon One系列自2019年推出以來,已廣泛應用於超大規模與資料中心網路,G300則進一步瞄準AI後端網路的高頻寬與低延遲需求。

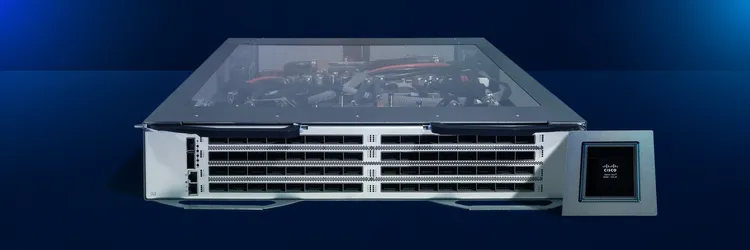

系統層面,思科同步推出搭載G300的N9000與8000系列交換器,提供風冷與液冷版本,其中全液冷設計可顯著提升頻寬密度並提高近70%能源效率,單一系統即可提供過往六套設備的頻寬能力,降低機櫃空間與耗電壓力。光學方案方面,思科導入1.6T OSFP光學模組,支援AI叢集高頻寬互連,同時推出800G線性可插拔光學(LPO),相較傳統方案最高可降低50%功耗,並將交換器整體能耗再降約30%,提升資料中心營運效率。

除了硬體升級,思科亦強化軟體與平台整合,升級Nexus One架構,透過統一管理層整合晶片、系統與光學模組,並導入AI Canvas與AgenticOps機制,以人機協作方式簡化網路營運與故障排除流程。新平台亦整合Splunk分析能力,提供從網路到GPU的可視化洞察,特別適用於主權雲與高合規環境,滿足企業對資料本地化與安全性的要求。

思科表示,Silicon One G300及搭載該晶片的系統與光學模組預計今年內開始出貨。隨著AI資料中心建設持續升溫,公司希望透過晶片、系統與軟體一體化布局,打造新一代AI網路基礎設施,進一步強化其在AI資料中心網路市場的競爭地位。

點擊閱讀下一則新聞

點擊閱讀下一則新聞