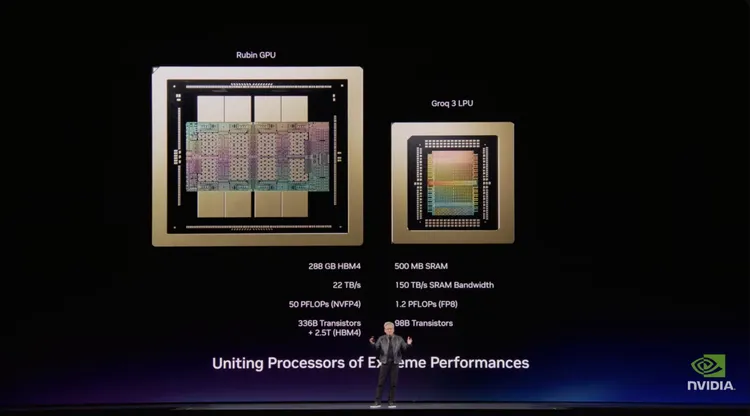

從架構設計來看,Vera Rubin平台將Rubin GPU與Groq LPU整合為新一代AI運算系統。Rubin GPU主要負責大型AI模型訓練與高算力推論,搭載288GB HBM4記憶體與22TB/s記憶體頻寬,運算能力達50 PFLOPS;Groq LPU則專為低延遲推論設計,透過高頻寬SRAM與專用架構提供即時AI推論能力。

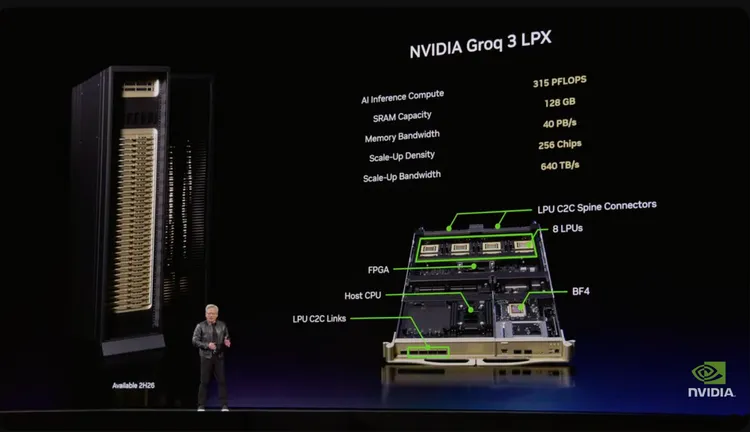

輝達指出,Groq 3 LPX機架搭載256顆LPU處理器、128GB片上SRAM與640TB/s互連頻寬,在大規模部署下,多顆LPU可被視為單一大型處理器運作,提供快速且可預測的AI推論能力。當LPX系統與Vera Rubin NVL72平台結合時,Rubin GPU與LPU可共同運算AI模型的每一層與每個輸出Token,大幅提升推論效率。

輝達估算,每兆瓦運算能力的推論吞吐量可提升最高35倍,並為兆參數模型創造最多10倍的營收潛力。LPX架構專為兆參數模型與百萬Token上下文需求設計,並採用液冷與MGX模組化架構,可直接整合至下一代Vera Rubin「AI工廠」。

在整體平台設計上,Vera Rubin整合Vera CPU、Rubin GPU、NVLink 6交換器、ConnectX-9 SuperNIC、BlueField-4 DPU、Spectrum-6乙太網路交換器,以及新導入的Groq 3 LPU推論加速器。透過深度系統協同設計,可支援從大規模預訓練(pretraining)、後訓練(post-training)、測試時擴展(test-time scaling)到即時Agent推理(agentic inference)等各類AI工作負載。

黃仁勳表示,目前Vera Rubin相關系統已進入全面量產階段,輝達已建立完整AI系統供應鏈,每週可製造數千台AI系統。若以整體運算能力計算,相當於每月可建置數GW等級的「AI工廠」,顯示AI基礎設施建設速度正快速提升。未來供應鏈也將同步生產Vera Rubin與GB200兩種機架系統,以支援持續成長的AI運算需求。

黃仁勳指出,Vera Rubin平台的早期採樣進展順利,相較於前一代Grace Blackwell在初期整合NVLink 72時的高度複雜度,Vera Rubin導入過程更加順暢。他並強調,在AI工廠架構與極致協同設計(co-design)的推動下,即使摩爾定律帶來的進步幅度有限,透過整體系統設計仍能帶來巨大效能躍升。以Token生成速度為例,在約兩年的時間內,1GW等級AI工廠的Token產生速度將從每秒200萬提升至7億,相當於約350倍的性能提升。

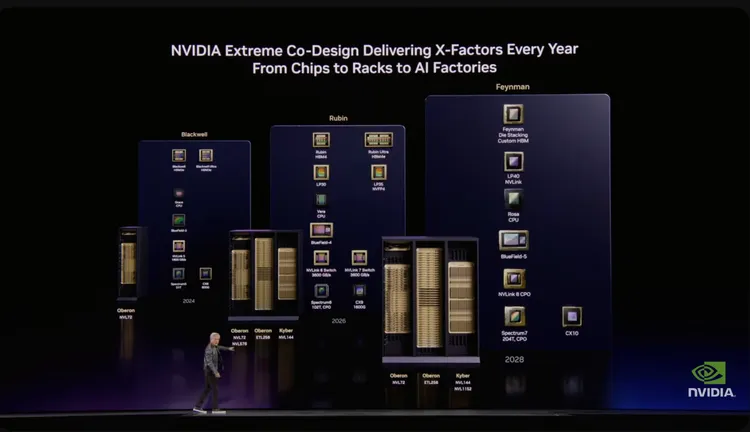

在產品路線圖方面,黃仁勳表示,目前Blackwell架構已推出,而Rubin平台將搭配Oberon系統。Oberon採用銅線擴充(copper scale-up)架構,同時也可透過光學橫向擴充(optical scale-out)將系統規模擴展至NVLink 576。面對市場對於銅線或光學擴充的討論,輝達策略是兩者並行,例如Kyber系統採用NVLink 144銅線擴充,而Oberon則透過NVLink 72搭配光學技術擴展至NVLink 576。

在Rubin之後,輝達也將推出下一代Rubin Ultra架構,目前相關晶片已進入試產階段,並將導入新一代LP35晶片與NV-FP4計算架構,預計帶來數倍效能提升。更長期來看,Rubin之後的下一代平台為Feynman,將搭載全新GPU與LP40處理器,同時導入新CPU架構「Rosa」,並搭配BlueField-5資料處理單元與下一代SuperNIC(CX10)網路架構。

黃仁勳在演講中也展示首款共封裝光學(CPO)Spectrum-X交換器晶片,採用輝達與台積電共同開發的「COUPE」技術,並已進入量產階段。市場預期,未來Feynman晶片可能採用台積電A16製程打造。黃仁勳強調,未來AI超級電腦與AI工廠的發展將同時依賴銅線與光學兩種技術路線,而輝達正同步布局兩種擴充方式,以支援快速成長的AI運算需求。

火線話題 | 輝達GTC宣告實體AI來了

這篇報導屬於「 輝達GTC宣告實體AI來了 」主題,更多延伸閱讀:

點擊閱讀下一則新聞

點擊閱讀下一則新聞